KI-System der nächsten Generation für bayerische Spitzenforschung

Das Leibniz-Rechenzentrum (LRZ) der Bayerischen Akademie der Wissenschaften erweitert seine Hochleistungsinfrastruktur um ein Cerebras CS-2-System mit HPE Superdome Flex Servern. Es bietet damit seinen Nutzerinnen und Nutzern – allen voran der bayerischen Spitzenforschung im Bereich KI – die nötigen Rechenkapazitäten, um große Datenvolumina mit Methoden der Künstlichen Intelligenz (KI) und des Maschinellen Lernens (ML) auszuwerten. Als erstes wissenschaftliches Rechenzentrum in Europa setzt das LRZ auf die Wafer Scale Engine 2 (WSE-2), den bis dato größten weltweit gefertigten Chip mit der höchsten Rechenleistung für smarte Datenverarbeitung. „Manchmal kommt es eben doch auf die Größe an – vor allem, wenn es um die Verarbeitung größter Datenmengen geht. Methoden von KI und das maschinelle Lernen brauchen viel Rechenkraft. Der neue Superchip des LRZ ist der bis dato größte weltweit und wird der bayerischen Spitzenforschung neue Wege öffnen. Mit ihm stärken wir nachhaltig den KI-Standort Bayern. Finanziert wird der Chip über Mittel aus der Hightech Agenda Bayern, der milliardenschweren Technologieoffensive des Freistaats“, so der Bayerische Staatsminister für Wissenschaft und Kunst, Markus Blume.

Turbo für bayerische KI-Forschung

Das LRZ erweitert kontinuierlich sein Portfolio heterogener Recheninfrastruktur, das neben Haupt- und Grafikprozessoren auch Spezialhardware wie FPGAs oder ASICS umfasst. Mit dem Cerebras-CS-2-System mit HPE Superdome Flex setzt das LRZ auf ein hoch leistungsfähiges System für die Verarbeitung von Big Data in Wissenschaft und Forschung: „Aktuell beobachten wir, dass sich der KI-Rechenbedarf unserer Nutzerinnen und Nutzer alle drei bis vier Monate verdoppelt. Mit der hohen Integration von Prozessoren, Speichern und On-Board-Netzwerken auf einem einzigen Chip ermöglicht das neue System Hochleistung und Tempo. Das verspricht deutlich mehr Effizienz bei der Datenverarbeitung und somit schneller bahnbrechende wissenschaftliche Erkenntnisse“, beschreibt Prof. Dr. Dieter Kranzlmüller, Leiter des LRZ, die Vorteile. „Als akademisches Rechen- und nationales Supercomputingzentrum stellen wir Forschenden hochperformante, zuverlässige IT-Dienstleistungen bereit. Um eine effiziente Nutzung sicherzustellen und Spitzenforschung auf dem System zu ermöglichen, werden wir gemeinsam mit unseren Nutzerinnen und Nutzern sowie unseren Partnern Cerebras und Hewlett Packard Enterprise ideale Anwendungsszenarien identifizieren und an deren Umsetzung feilen.“ Zu den möglichen Use Cases zählen die Verarbeitung natürlicher Sprache (Natural Language Processing, NLP), die medizinische Bildverarbeitung mit innovativen KI-Algorithmen zur Analyse medizinischer Bilder sowie die numerische Strömungsmechanik (Computational Fluid Dynamics, CFD) zur Verbesserung des Verständnisses in Bereichen wie Luft- und Raumfahrttechnik sowie Fertigung.

KI-System der nächsten Generation mit skalierbarer und beschleunigter Rechenleistung

Das neue KI-System am LRZ wurde speziell für die Verarbeitung großer Datenmengen und zur Bewältigung komplexer wissenschaftlicher Fragestellungen entwickelt. Es besteht aus dem HPE Superdome Flex Server und dem Cerebras CS-2-System, das in dieser Kombination in Europa zum ersten Mal verfügbar gemacht wird. Der HPE Superdome Flex Server bietet eine modulare, skalierbare Lösung, um den Rechenanforderungen gerecht zu werden, und verfügt über spezielle Funktionen für große In-Memory-Verarbeitungen, die für die Auswertung riesiger Datenmengen erforderlich sind. Darüber hinaus sind die spezifischen Vor- und Nachbearbeitungsfunktionen des HPE Superdome Flex Servers für das Training und die Inferenz von KI-Modellen ideal. Es unterstützt so das Cerebras CS-2-System, das die Deep-Learning-Leistung von Hunderten von Grafikprozessoren (GPUs) mit der einfachen Programmierung eines einzelnen Knotens bietet.

Der zurzeit größte Chip mit 850.000 Rechenkernen

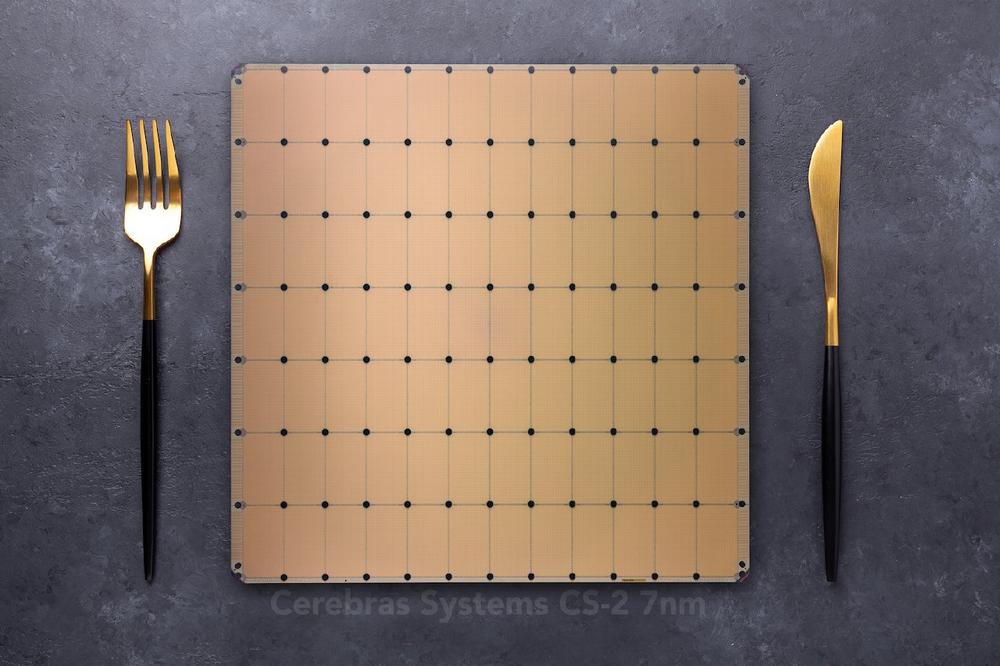

Herzstück des Cerebras-Systems ist daher die Wafer Scale Engine der zweiten Generation (WSE-2), ein matt golden schimmernder Prozessor, der so groß ist wie ein Essteller. Auf den etwa 46.000 Quadratmillimetern Silizium sammeln sich 2,6 Billionen Transistoren und 850.000 Rechenkerne, die speziell für Verfahren von KI entwickelt wurden, außerdem gleichmäßig verteilte Speicher, die bis zu 40 Gigabyte Daten fassen, sowie schnelle Verbindungen für deren Transport über die Platte mit 220 Petabyte pro Sekunde. So kann WSE-2 während der Ausführung alle Parameter von vielschichtigen, neuronalen Netzen auf einem Chip halten, was wiederum die Rechenzeit und Datenverarbeitung verkürzt. Bisher kommt das Cerebras CS-2-System in einigen US-amerikanischen Forschungseinrichtungen zum Einsatz. „Wir haben Cerebras gegründet, um die Zukunft des Computing zu revolutionieren“, sagt Andrew Feldman, CEO und Mitbegründer von Cerebras Systems. „Wir sind stolz darauf, mit dem LRZ und HPE zusammenzuarbeiten, um der bayerischen Forschungscommunity Zugang zu KI der Spitzenklasse zu verschaffen. Diese wird es ihnen ermöglichen, neue Hypothesen zu testen, große Sprachmodelle zu trainieren und letztlich die wissenschaftliche Forschung voranzutreiben.“

Supportsystem und Software für die Entwicklung von KI-Methoden

Der HPE Superdome Flex Server komplettiert die CS-2 und bietet zusätzlich große Speicherkapazitäten und eine enorme Skalierbarkeit der Rechenleistung. So ist das integrierte System ideal abgestimmt auf die riesigen, datenintensiven ML-Projekte, die zu den klassischen Anwendungsfällen des Cerebras Systems zählen. Außerdem plant und verwaltet der HPE Superdome Flex Server das System entsprechend der Anforderungen verschiedener Anwendungen und ermöglicht den Zugriff via Cloud. Darüber hinaus enthält der HPE Superdome Flex Server einen Softwarestack mit Programmen zur Erstellung von KI-Verfahren und -Modellen.

„Wir freuen uns, unsere Zusammenarbeit mit dem Leibniz-Rechenzentrum zu erweitern mit Computer-Technologie der nächsten Generation für die wissenschaftliche Gemeinschaft“, sagte Justin Hotard, Executive Vice President und General Manager, HPC & AI, HPE. „Zusammen mit dem Leibniz-Rechenzentrum und Cerebras unterstützen wir die nächste Welle wissenschaftlicher und technischer Innovationen in Deutschland. Mit der zunehmenden Verbreitung von KI und maschinellem Lernen werden hochoptimierte Systeme wie dasjenige des LRZ wissenschaftliche Durchbrüche zum Wohle der Menschheit beschleunigen.“

Zusätzlich zu Anwendungsfällen aus dem KI-Umfeld wird das Cerebras/HPE-System auch für traditionellere High-Performance Computing (HPC) Use Cases in Betracht gezogen, wenn die spezielle Rechenarchitektur den Eigenschaften der Anwendung entgegenkommt. „Die Zukunft des Computings wird komplexer, die Systeme werden heterogener und auf spezifische Anwendungen abgestimmt. Wir sollten aufhören, in HPC- oder KI-Systemen zu denken“, sagt Laura Schulz, Head of Strategy am LRZ. „Auf CPU-basierten Systemen wie dem SuperMUC-NG funktionieren KI- Verfahren, und umgekehrt können High Performance Computing-Algorithmen große Leistungssteigerungen auf Systemen wie Cerebras erzielen. Wir arbeiten kontinuierlich daran, dass sich unsere Nutzerinnen und Nutzer auf ihre For-schung konzentrieren können – ganz egal, ob die zugrundeliegende Infra-struktur auf HPC-, KI- oder Quantentechnologie basiert.“

Das Leibniz-Rechenzentrum der Bayerischen Akademie der Wissenschaften ist seit sechs Jahrzehnten der kompetente IT-Dienstleister der Münchner Universitäten und bayerischen Hochschulen sowie Kooperationspartner wissenschaftlicher Einrichtungen in Bayern, Deutschland und Europa. Es bietet die komplette Band-breite an IT-Dienstleistungen und -Technologie sowie Beratung und Support – von E-Mail, Webserver, bis hin zu Internet-zugang, virtuellen Maschinen, Cloud-Lösungen und dem Münchner Wissenschaftsnetz (MWN). Mit dem Höchstleistungsrechner SuperMUC-NG gehört das LRZ zu den international führenden Supercomputing-Zentren und widmet sich im Bereich Future Computing schwerpunktmäßig neu aufkommenden Technologien, Künstlicher Intelligenz und Machine Learning sowie Quantencomputing.

Bayerische Akademie der Wissenschaften

Alfons-Goppel-Straße 11

80539 München

Telefon: +49 (89) 23031-1141

Telefax: +49 (89) 23031-1281

http://www.badw.de

Leiter Kommunikation Deutschland, Österreich, Schweiz

Telefon: +49 (7031) 45024-63

E-Mail: patrik.edlund@hpe.com

Leitung Öffentlichkeitsarbeit

Telefon: +49 (89) 35831-8887

E-Mail: schulte@lrz.de

Presse- und Öffentlichkeitsarbeit und Junges Kolleg

Telefon: +49 (89) 23031-1336

Fax: +49 (89) 23031-1285

E-Mail: presse@badw.de

![]()